生成AIを効果的に活用するには、押さえておくべき勘所があります。ただ闇雲に使っても、欲しい解答が得られないばかりか、「尤もらしいだけで根拠に欠く答え」で仕事の邪魔をされることも多々です。

AIの出力の妥当性を判断するには、使う側(=ユーザー、人間)にも知識と思考力が必要です。便利さにかまけてAIに頼ってばかりでは、人間本来の強みを鍛えられず、AIを上手に使えなくなります。

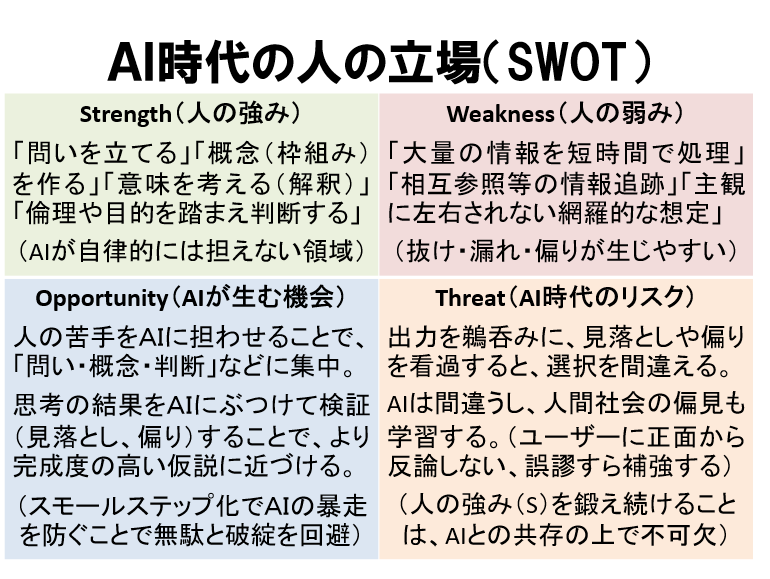

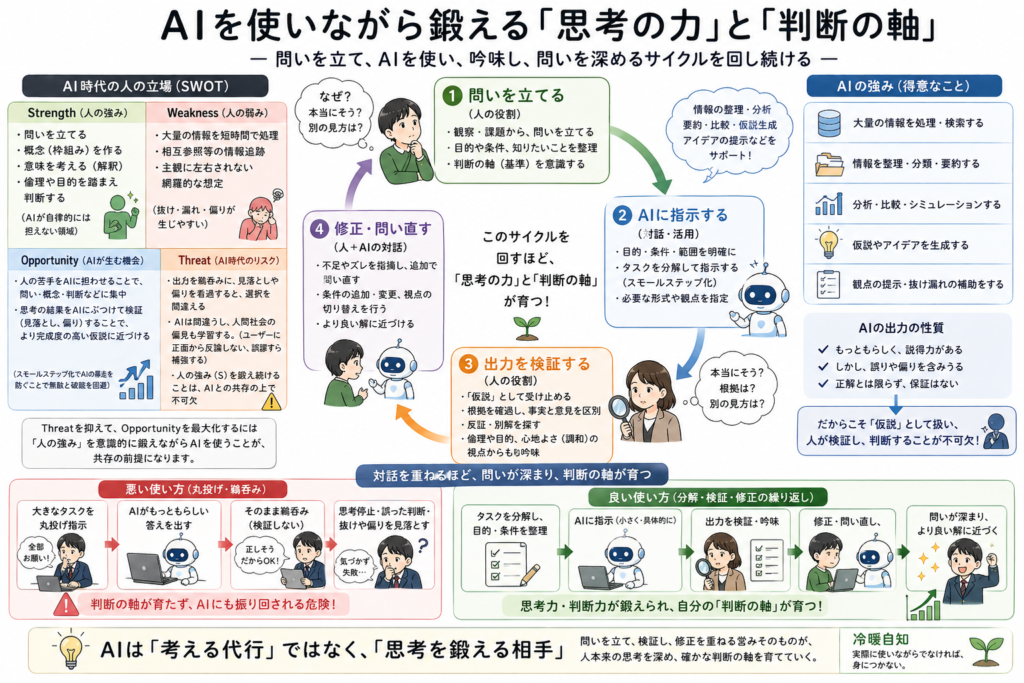

下表に示すSWOT(強み、弱み、チャンス、リスク)を正しく捉えた上で、どんな力を自らの内に養っていくか、AIにどのような指示を与え、その出力をどう検証し、必要に応じて修正していくかを、常に考え続ける必要があるのだろうと思います。

これらは誰かに教わることではなく、実際にAIを使いながら、出てきた問題の一つひとつにどう対処するかを自ら考える中で、理解を深めていくべきものかもしれません。敢えて言えば「冷暖自知」ですね。

Threatを抑えて、Opportunityを最大化するには「人の強み」を意識的に鍛えながらAIを使うこと。それが、AIとの共存の前提です。

この前提に立ったとき、教室でのAI活用において押さえておくべき最低限の視点は何か。ここでは、「指示」「検証」「修正」という一連の流れの中で、見落としてはならないポイントを整理しておきます。

❏ 問いや判断の軸を手放さない(人の強みを鍛える)

上表に示した通り、「問いを立てる」「概念(枠組み)を作る」「意味を考える(解釈)」「倫理や目的を踏まえ判断する」といった営みは、人間にアドバンテージがある領域。AIが自律的に担うのは困難です。強みを手放さず、高めないと、AIとの共存が混迷を招きかねません。

観察した事象の中に解決すべき問題を見出したり、新たな価値を描き出す概念を構築したりする力を、日々の学習や職業生活の中できちんと鍛えないと、AIに適切なプロンプトを渡すこともできません。

AIの出力が妥当か、人々の理解と共感を得られるかなどを判定するのも、人間が手放してはいけないことの一つです。確率で答えを導くAIは「心地よさ」の判定も苦手です。人が、心地よさ[調和]が生まれる原理を学ぶことで、しっかりと舵を握り続けることが求められます。

❏ AIの出力を「答え」ではなく「仮説」として扱う

AIの出力が、正解である保証のないもの、誤りや偏りを含みうるものであるのは、改めて申し上げるまでもありません。どれだけ尤もらしく整っていても、妥当であるとは限らず(両者はまったく別の次元にあるもの)、常に「検証すべき仮説」として扱う必要があります。

AIは文章を流暢に、構造的に、説得力ある形で生成します。だからこそ、誤りが誤りとして見えにくい。文章の体裁が整っているほど、読み手の批判的な目は緩みがちになることを忘れないようにしましょう。

出力の採否・修正の判断は人間が責任を負うところ。「これは使える、ここはおかしい」「この方向では目的に合わない」という判断を下せるのは、問いの文脈を知り、目的を持ち、意味を問える人間だけです。

同じことは、生徒にAIを利用させる(=学習に使わせる)ときにも当てはまります。以下の2つをきっちり習慣化させることと、その前提として、それぞれの意味を正しく理解させることが何よりも肝要です。

- 「説得力がある」と「正しい」は別のことだと、常に意識する

- 出力を受け取ったら、まず「本当にそうか」と立ち止まる

生徒がAIの答えをそのまま写してくるようなら、「まず疑う」「根拠を確かめる」という姿勢と習慣の学習がまだ不十分ということ。丸写しを叱る前に、そこまでの指導を省みる必要がありそうです。

❏ タスクを分けて扱う(スモールステップ化)

AIの出力が崩れやすいのは、大きなタスクを分解せずに渡したとき。例えば、「この問題について、(現況の調査・整理に基づく)コスパに優れた解決策を提案して」といった「丸投げ指示」は、人間でも負荷が大きくなりがち。躓きや迷走が生じたら、指示する側の責任でしょう。

AIに対しても、一つのプロンプトで全作業を一気にやらせようとするほど、あちこちで綻びが生じ、出力が怪しいものになっていきます。

有効なのはタスクの分解。「現状を調べて整理する」「各々に解決策を考案」「優先度と費用を算出」「それを踏まえてタスクの書き出し」といった具合に指示を分けて、段階的に回答を出力させると、各段階での出力の質が上がり、妥当性・合理性の検証も容易です。

どの段階で何が返ってきたかが明確になるため、プロンプトを修正していくのも容易になり、AIへの指示の出し方も上達が加速します。

複雑な問題を一気に解こうとせず、分解し、順に確かめながら進めることは、生徒に対してのみならず、AIに対しても有効ということです。

❏ 何をさせたいか、目的や条件を明確にする

AIの利活用では、プロンプトの書き方を「技術」として捉える向きがあります。「言い回しを工夫すれば、AIはより良い答えを返してくれる」というのも間違いではありませんが、本質はそこにありません。

大切なのは、言い回しの妙ではなく、「何を求めているか」「何を条件にするか」「何を除外したいか」をユーザー側が明確にしていること。

目的・条件・範囲の三点が固まっていれば、多少ぎこちない/まどろっこしい表現でも、AIは概ね意図を汲んだ答えを返してくれます。

逆に、これが曖昧なまま言葉だけ整えても、出力は的外れになるということ。プロンプトを書く力とは、「問いを立てる力」「条件を整理する力」「求めるタスクを整理・構造化する力」の延長線上にあります。

❏ 出力を検証し、改めて問い返す(修正しながら使う)

AIが返してきた答え(出力)は、常に「本当にそうか」「なぜそう言えるか」「別の見方はないか」を疑ってみる習慣を持ちましょう。騙されていることに気づかないで不利益を被るのは他ならぬユーザーです。

こうした意識で出力を吟味し、誤りや論理の飛躍、視点の偏りが疑われたらすぐに追加の指示や反論で、回答させ直しましょう。一度の出力で完結するのではなく、「対話を重ねる姿勢」が出力の質を高めます。

情報リテラシーを学ばせるとき、生徒にはネットで検索した結果を鵜呑みにさせないように指導しますが、AIを活用させるときは、さらに注意深さが求められます。いわゆる「ノークリック検索」では、嘘や矛盾に気づくのが一層難しいことを忘れないようにしたいものです。

検証のために、複数のモデルのAIを併用(同じ問いを投げてみる)したり、出力を他のAIに評価させたりするのは、その手軽さからも十分に「アリ」です。但し、どのモデルも似た材料を学習しているためか、誤りや偏りまで共有することもあり、万全の信頼はおけません。

❏ 問い/プロンプトの修正を重ねて、判断の軸を確立する

AIとのやり取り(対話)の中で、指示を手直しする、条件を加える/削る、別の観点を求めるといった修正を繰り返すことで、AIの出力は徐々に目的に近づいていきます。しかしここで大切なのは、修正という行為が、単なる後処理ではないということです。

出力されてきたものに対して、「ここが足りない」「この表現はズレている」「この論理には飛躍がある」と判断するたびに、自分の中の基準がより明確に言語化されていきます。プロンプトの修正を重ね、出力をやり直させることは、言わば自分自身の判断基準を育てる訓練です。

AIを使うほどに、AIへの依存が高まるのではなく、むしろ自分の中の軸がしっかりしていくというのが、好ましい使い方でしょう。そういう関わり方ができるかどうかが、AIを使った未来を変えます。

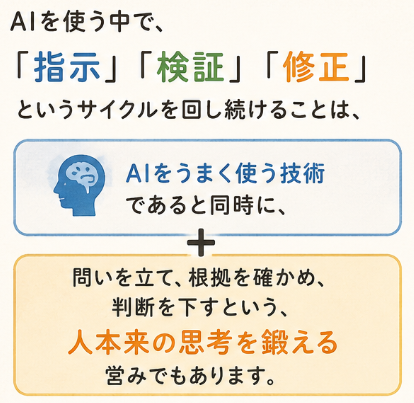

AIを使う中で、「指示」「検証」「修正」というサイクルを回し続けることは、AIをうまく使う技術であると同時に、問いを立て、根拠を確かめ、判断を下すという、人本来の思考を鍛える営みでもあります。

道具を使いながら、使う側がさらに育っていく(必要な能力を高める)ことが大事。AIの利活用では、自分の中に「問い」や「判断の軸」を育めるかが問われます。冒頭に「冷暖自知」と書きましたが、これらはまさに「実際に使いながら」でなければ身につかないものでしょう。

生徒に、AIの利活用を指導しなければならない場面が必ず来ますが、まずは先生方がきちんと(正しく)使えないことには、指導に覚束ないところが生じます。本稿の内容が少しでもその土台になれば幸いです。

■関連記事:

このイラストは、本稿をもとにChatGPTで作成したものです。

校内研修・授業利用であれば、事前連絡なくご利用いただいて構いません。

教育実践研究オフィスF 代表 鍋島史一